自社で作成した画像やテキスト、動画といった大切なコンテンツが、知らない間にAIの学習データとして無断利用される…

そんなデジタル時代特有のリスクから、あなたの資産を守るのが「AI学習防止ツール」です。

AIモデルの学習を抑止する技術は大きな進化を遂げており、画像へのノイズ付加や電子透かし(ウォーターマーク)の埋め込み、Webサイトへのクローリングを拒否するオプトアウト支援など、そのアプローチは多岐にわたります。

本記事では、現在主流となっているAI学習防止ツールの中から、特におすすめの4つのツールを特徴や用途ごとにランキング形式で詳しくご紹介します。

もし、AI学習防止ツールの導入や選定に迷ったら「AI活用研究所」の利用がおすすめです。

お問い合わせ後2営業日以内に提案するほか、豊富な知見を持つ専門家が、貴社のコンテンツ特性やリスクレベルを分析し、最適なツールの選定を支援します。

\相談だけでも大丈夫!/

AI学習防止をすべき理由

自社の著作物や機密データがAIの学習に無断で利用されると、ビジネス上無視できない深刻なリスクが生じます。

一度AIモデルに取り込まれたデータは、完全に取り除くことが困難なケースが多いため、事前の対策が欠かせません。

ここでは、AI学習防止をすべき主な理由について解説します。

著作権の侵害とクリエイターの権利保護

インターネット上に公開した作品がAIに学習されると、画風や構成を模倣した二次創作物が生成される可能性があります。

これにより、オリジナルのクリエイターへの正当な対価や評価が阻害される恐れがあるでしょう。

現行制度では、AI学習を一律に制限する仕組みは限定的であるため、技術的な防衛策が重要となります。

つまり自分の権利を自分で守るという意識を持ち、ノイズ付加などの対策を施すことが求められます。

作品の権利を保護してクリエイティブな活動を継続するために、防止ツールの導入は有効な対策の一つです。

企業の機密情報やノウハウの流出防止

社内ドキュメントや独自のソースコードが学習データに含まれると、設定や利用方法によっては、競合他社のAI利用時に自社情報が回答に反映されるリスクがあります。

たとえ悪意がなくても、生成AIの出力結果を通じて間接的に企業秘密が外部に漏洩する可能性は否定できません。

そのため、開発環境や社内ツールにおいて、データが学習に利用されない設定を適切に管理することが重要です。

したがって情報の出口管理を強化することが、企業の競争力を維持するための重要な課題の一つです。

重要な知的財産をAIの学習対象から除外すると、情報漏洩の不安を軽減できる可能性があります。

AI学習防止ツール7選

AI学習防止ツールは、無断でAIモデルに利用されるリスクに対抗し、著作物やコンテンツを保護するための技術です。

多様な防止技術が登場しており、ノイズ加工やウォーターマーク埋め込み、オプトアウト支援など多角的に学習を阻止する方法が生み出されています。

信頼できるツールを選ぶためには、有効性や対応メディア、導入のしやすさを比較検討することが重要です。

ここからは、おすすめのAI学習防止ツールを種類別にランキング形式で紹介し、特徴や用途を分かりやすく解説します。

著作物やコンテンツをAIから守るための方法として、最適な防止ツール選びの参考にしてください。

| ツール名 | 特徴 | 費用 | おすすめ企業の特徴 |

|---|---|---|---|

| Glaze | 画像データにノイズを付加し学習防止 | 無料 | クリエイター、アート関連企業 |

| Nightshade | 生成AIモデルへの学習阻害技術 | 無料 | 大規模コンテンツプロバイダー |

| ArtShield | 見えない透かしで画像をAI学習から保護 | 無料 | デジタルアート制作企業、コンテンツ配信メディア |

| Content Credentials | 透明な権利情報タグ付けを実現 | 無料 | メディア企業、プラットフォーム |

| Mist | オープンソースのデータポイズニングによる学習防止 | 無料 | 技術力のあるクリエイター、研究機関 |

| PhotoGuard | MITが開発した画像への微細な摂動付加で改変を阻止 | 無料 | 研究者・エンジニア、ディープフェイク対策を重視する企業 |

| HIVE | 生成AIコンテンツを検出・分類するAIプロテクター | 無料 | メディア企業、フェイク画像対策を進めたい企業 |

Glaze

| 項目 | 内容 |

|---|---|

| 料金 | 無料 |

| 開発者 | 米シカゴ大学の学術研究グループ |

| 所在地 | 米国シカゴ |

| 公式サイト | https://glaze.cs.uchicago.edu/jp/index.html |

Glazeは、シカゴ大学の研究チームが開発した高性能なAI学習防止ツールです。

画像に人間の目にはほとんどわからない特殊なノイズを加え、AIモデルがデータを正確に学習するのを妨害します。

この技術は、無断でのAI学習を抑制し、クリエイターの作品の権利を守ることに役立ちます。

無料で利用でき、ローカル版やWeb版があり、導入が比較的簡単なのも魅力です。

継続的に利用することでAI学習への影響を強め、法的・制度の記載が整うまで保護ができると期待されています。

| 口コミ |

|---|

| highだと絵に強く表れてしまうため、low(三枚目)で十分そうです。 PCで絵を描く人は試してみてもいいかも!|引用:X |

| 代表的なのはglazeっていうツールだと思う。AIに対策するために永続的に開発をしていて、1番効果があるけど公式のXやブルスカにDMして認証されないと使えないのが少しネック。|引用:X |

Nightshade

| 内容 | 詳細 |

|---|---|

| 料金 | 無料 |

| 開発者 | シカゴ大学研究チーム |

| 所在地 | アメリカ合衆国、シカゴ |

| 公式サイト | https://nightshade.cs.uchicago.edu/whatis.html |

Nightshadeは画像に人間の目にはほとんど気づかれない「データポイズニング」を加え、AIの学習プロセスを妨害します。

独自の仕組みにより、画像生成AIが正しい特徴を学習できず、不正利用を防止できるため、企業は著作権保護やコンテンツ流用対策の強化が可能です。

継続的に使用することで、AIによる無断学習を抑制し、クリエイターの権利を守る有力な手段となります。

| 口コミ |

|---|

| 私は芸術の学校に通っているんですけどGlazeとNightshadeが先生からのおすすめされたAI学習防止ツールです|引用:X |

| Nightshade使おう!まだPC版しかないけど!確実に効果はあるよ!!|引用:X |

ArtShield

| 項目 | 内容 |

|---|---|

| 料金 | 無料 |

| 開発者 | ArtShieldチーム |

| 所在地 | ペンシルベニア州フィラデルフィア |

| 公式サイト | https://artshield.io/ |

ArtShieldは画像に目に見えない透かし(ウォーターマーク)を埋め込む技術を活用し、AIのスクレイピングや無断学習を効果的に阻止します。

企業は自社コンテンツの著作権侵害やブランド価値の毀損を防ぎ、安心して素材配信が可能となります。

単体よりGlazeやNightshadeなど他の防御ツールと併用することで最大限の効果を発揮するのが特徴です。

| 口コミ |

|---|

| パッと見わからないけど、色調いじるとちゃんとノイズ乗ってる しかも加工時間結構短い!|引用:Threads |

Content Credentials

| 項目 | 内容 |

|---|---|

| 料金 | 無料 |

| 開発者 | Adobe Inc. |

| 所在地 | 米国カリフォルニア州サンノゼ |

| 公式サイト | https://contentcredentials.org/ |

Content Credentialsは、デジタル作品に作成者情報や編集履歴、AI学習利用の可否を含む改ざん防止のメタデータを付与し、作品の出所と利用条件を透明化します。

企業は、自社のクリエイティブ資産が無断でAI学習に使われるリスクを軽減でき、知的財産保護やブランド信頼性強化に貢献します。

AI学習のオプトアウト機能によって、企業独自のコンテンツが外部AIモデルに取り込まれないよう制御可能です。

| 口コミ |

|---|

| Adobeアカウントさえあれば誰でも簡単に、任意の画像に連絡先と生成AIに対するスタンスを埋め込めます。|引用:note |

| 自分のイラストを守る手段のひとつとして、イラストに自分の情報などを埋め込める Content Credentials(コンテンツクレデンシャル)はとても有効なんじゃないかなと思っています。|引用:Threads |

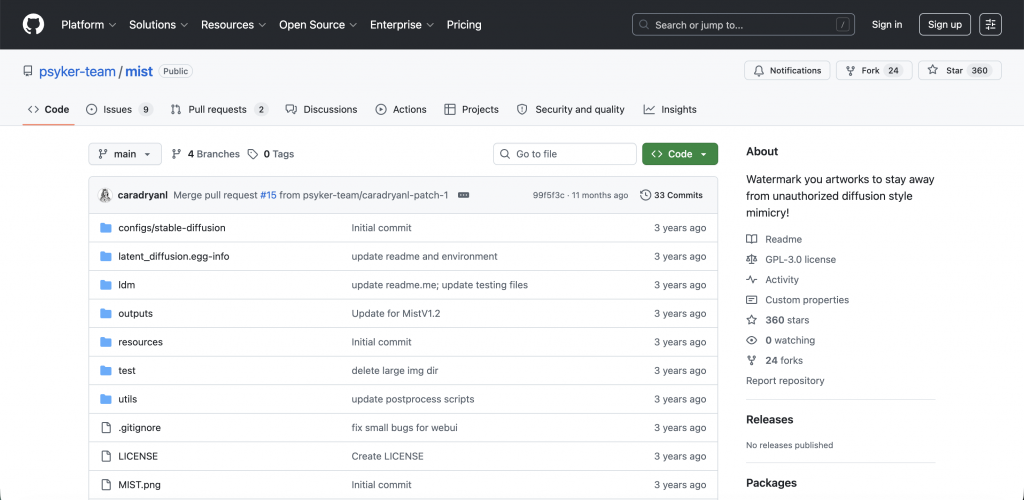

Mist

| 内容 | 詳細 |

|---|---|

| 料金 | 無料 |

| 開発者 | 上海交通大学研究チーム |

| 所在地 | 中国 |

| 公式サイト | https://github.com/psyker-team/mist |

Mistは、上海交通大学研究チームが開発したオープンソースの画像生成AI学習防止システムです。

AI学習から保護するサービス「emamori」のイラスト保護技術には、Mistを採用しています。

画像に人間の目にはほとんど気づかれない「データポイズニング」を加え、AIの学習プロセスを妨害します。

独自の仕組みにより、画像生成AIが正しい特徴を学習できず、不正利用を防止できるため、企業は著作権保護やコンテンツ流用対策の強化が可能です。

GitHubで公開されているオープンソースツールのため、技術的な知識があれば自由にカスタマイズして利用することもできます。

| 口コミ |

|---|

| 自分の絵を改変されたり、交流の場も大量の生成AI画像に押し流され荒らされて心身を病んでしまっている若い絵描きさん方も数多くいらっしゃいます。そんな中「emamori」という絵描きが自分の絵を守りAIの学習に使われたくないと意思表示できる手段を得たことがありがたいです。|引用:PR TIMES |

| なるほど、これは面白い。AI技術の発展を止めるのは難しいし、むしろ発展するべきと考えているから、並行してAIに学習させない技術もどんどん発展していくと良いですね(゜_゜)|引用:X(旧Twitter) |

PhotoGuard

| 項目 | 内容 |

|---|---|

| 料金 | 無料 |

| 開発者 | アメリカのマサチューセッツ工科大学(MIT)のCSAIL(Computer Science and Artificial Intelligence Laboratory) |

| 所在地 | アメリカ |

| 公式サイト | https://www.csail.mit.edu/ |

PhotoGuardは、アメリカのマサチューセッツ工科大学(MIT)のCSAIL(Computer Science and Artificial Intelligence Laboratory)が開発した、生成AIによる画像改変を阻止する技術です。

画像に目に見えない微細な摂動(パータベーション)を付加することで、Stable DiffusionなどのAIモデルが対象画像を正確に認識・学習できないよう干渉します。

GitHubでコードが公開されており、研究者やエンジニアが実装・検証しやすい形で提供されているのが特徴です。

単体よりGlazeやNightshadeなど他の防御ツールと組み合わせることで、多層的な保護効果が期待できます。

| 口コミ |

|---|

| フォトガードによって「免疫を与えられた」画像を編集しようとすると、その結果は非現実的な見た目になったり、ゆがんで見えるものになる。|引用:MIT Technology Review |

| PhotoGuardを適用した画像(Immunized Image)は元の画像と見分けが付きませんが、AIに上記と同様の指示を与えても不自然な画像に仕上がっています。|引用:X(旧Twitter) |

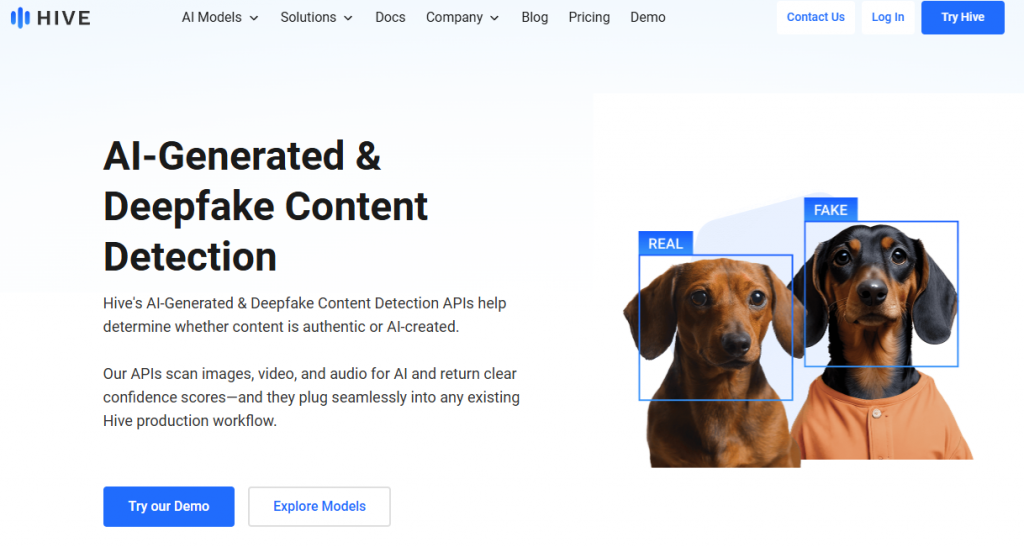

HIVE

| 項目 | 内容 |

|---|---|

| 料金 | 無料 |

| 開発者 | HIVE |

| 所在地 | アメリカ・サンフランシスコ |

| 公式サイト | https://thehive.ai/apis/ai-generated-content-classification |

HIVEは、2013年に設立されたHIVE社が提供する、生成AIコンテンツを検出・分類するAIプロテクターです。

デジタル作品に作成者情報や編集履歴、AI学習利用の可否を含む改ざん防止のメタデータを付与し、作品の出所と利用条件を透明化します。

企業は自社のクリエイティブ資産が無断でAI学習に使われるリスクを軽減でき、知的財産保護やブランド信頼性の強化に貢献するツールです。

AI生成コンテンツの検出精度の高さが特徴で、フェイク画像やディープフェイクの判別にも活用されています。

| 口コミ |

|---|

| 2023年の4月にHiveで調べた時は、「60%AIで40%手描き」と判定された画像もありました👇これは過去に、色々な人にツッコまれていた部分であり、「AIの判定は微妙」という空気があったように思います。しかし、1年後の今、改めて同じ画像を調べてみると、「AI生成の確率99%」と判定されるようになりました👇|引用:VTuber西カクヨのブログ |

| AIが生成した画像を見抜く「Hive」。これはどのAIエンジンを使ったかまで判る。「AI or Not」(AIかどうか)は写真の判別に強さを発揮する。「生成AIチェッカー」はAIが生成した文章を見抜く。これらをうまく使って騙されないようにしよう。|引用:X(旧Twitter) |

【企業向け】AI学習防止策

企業の大切な情報資産を守るためには、ツール導入だけでなく組織的な対策も必要です。

ここでは、企業が取り組むべきAI学習防止策について具体的に解説します。

AI学習から社内ドキュメントやナレッジを守る

社内情報の流出は、企業の競争力を低下させる重大なリスクになり得ます。

特に、生成AIに入力したプロンプトやアップロードしたデータが学習に利用される点が懸念です。

そのため、入力データが学習されない設定(オプトアウト)が可能なツールを選ぶべきです。

また、社内専用の環境を構築し、外部へのデータ送信を遮断する措置も有効といえます。

重要なナレッジを守るために、まずは技術的な防壁を築くことが第一歩です。

クラウドサービス利用時の契約・規約確認する

外部のクラウドサービスを利用する際は、利用規約の確認が欠かせません。

無料版では学習に利用される可能性がある一方、企業向け有料プランでは学習に利用しないと明記されているケースが多いです。

したがって、コスト削減だけでツールを選ばず、データポリシーを細部まで確認しましょう。

API経由の利用であれば学習データとして使用されない場合もあるため、仕様の理解も必要です。

契約内容を正しく把握し、意図しないデータ流出を未然に防ぐことが肝要です。

守りたい資産の種類と許容できるコストを基準に選ぶ

守るべき資産が画像なのか、テキストやソースコードなのかで対策は異なります。

画像であればノイズ付加ツール、テキストであればアクセス制限などが選択肢に入ります。

また、導入にかかる費用や運用工数といったコスト面も無視できない重要な要素です。

リスクの大きさと対策コストを天秤にかけ、費用対効果の高い手段を選定してください。

すべてのデータを守るのではなく、優先順位をつけて対策を講じることが現実的です。

社内のAI活用ガイドライン作成する

ツール導入だけでなく、社内での利用ルールを明確化したガイドラインが必要です。

具体的には、入力して良い情報の範囲や、業務で利用可能なAIツールの指定などを定めます。

機密情報や個人情報の入力を禁止することで、人的ミスによる流出リスクを低減できます。

加えて、ガイドラインは一度作って終わりではなく、技術の進化に合わせて更新しましょう。

明確な基準を示すことで、従業員が迷わずに比較的安全な方法でAIを活用できる環境を作ります。

従業員へAI防止意識を啓発する

どれほど強固なシステムやルールを作っても、最終的には人の意識が重要になります。

「なぜAI学習を防止する必要があるのか」という背景やリスクを、従業員に伝えましょう。

定期的な研修や勉強会を実施し、リテラシーを向上させる継続的な取り組みが求められます。

さらに、他社の情報漏洩事例などを共有することで、当事者意識を持たせることも効果的です。

組織全体でセキュリティ意識を高めることが、最も確実な防御策となります。

まとめ|AI学習防止ツールを導入して安全対策を強化しよう!

AI学習防止は、単一のツールを導入すれば万全というわけではありません。

自社が保有するコンテンツの種類、公開範囲、そしてどのようなリスクを最も避けたいのかを明確にし、目的に応じてこれらのツールを組み合わせ、多層的に対策を講じることが成功のカギとなります。

もし「どのツールをどう組み合わせれば良いかわからない」「自社のリスクレベルに応じた最適な対策を知りたい」とお悩みでしたら、無料で利用可能な「AI活用研究所」にご相談ください。

AI活用の専門家が、貴社の状況を丁寧にヒアリングし、おすすめのツール選定をサポートします。

各企業でAI活用が進んでいる今だからこそ、プロフェッショナルのサポートを受けてみませんか。

\相談だけでも大丈夫!/

おすすめのサイバーセキュリティAIツールを知りたい方は、以下の記事をご覧ください。

AI学習防止に関するよくある質問

AI学習防止ツールの導入を検討する際に、多くの企業やクリエイターが抱く代表的な疑問点について回答します。

- 防止ツールを使えば100%学習を防げますか?

-

残念ながら、最新のツールを使用してもAIの学習を完全に100%遮断することを保証するものではありません。

AIの学習アルゴリズムは日々進化しており、防止技術を回避する手法が開発される可能性があります。

そのため、単一の対策に頼るのではなく、複数の防止策を組み合わせてリスクを低減することが重要です。

- 画像にノイズを入れると見た目が悪くなりませんか?

-

Glazeなどのツールによるノイズ付加は、人間の目には大きな違和感が出にくいレベルで加工をおこなう技術に基づいています。

一見すると元の画像と変わりませんが、AIの特徴量認識を誤らせる仕組みです。

ただし、防御の強度を最大に設定した場合には、細部にわずかな質感の変化や違和感が生じることもあります。

そのため公開する媒体や目的に応じて、防止の強度と画質のバランスを適切に調整しましょう。

視覚的な美しさを損なわずに学習を阻害する技術は、現在も急速に改良が進んでいます。

- 防止ツールの利用に法的な問題はありませんか?

-

一般的には違法とされるものではありませんが、利用環境によっては注意が必要です。

むしろ、権利保護のための技術的な対策の一つです。

また、Adobeが推進する「Content Credentials」のように、国際的な標準規格として普及が進んでいる技術も存在します。

したがって、正当な権利行使の一環として、適切に利用すれば有効な対策の一つといえます。